Comprimindo modelos AI em microcontroladores

O que você ganha quando cruza AI com a IoT? A inteligência artificial das coisas (AIoT) é a resposta simples, mas você também obtém uma nova área de aplicação enorme para microcontroladores, possibilitada por avanços nas técnicas de rede neural que significam que o aprendizado de máquina não está mais limitado ao mundo dos supercomputadores. Hoje em dia, os processadores de aplicativos de smartphone podem (e fazem) realizar inferência de IA para processamento de imagens, mecanismos de recomendação e outros recursos complexos.

Trazer esse tipo de capacidade para o humilde microcontrolador representa uma grande oportunidade. Imagine um aparelho auditivo que pode usar IA para filtrar o ruído de fundo de conversas, eletrodomésticos inteligentes que podem reconhecer o rosto do usuário e mudar para suas configurações personalizadas e nós de sensores habilitados para IA que podem funcionar por anos com a menor das baterias. O processamento de dados no terminal oferece vantagens de latência, segurança e privacidade que não podem ser ignoradas.

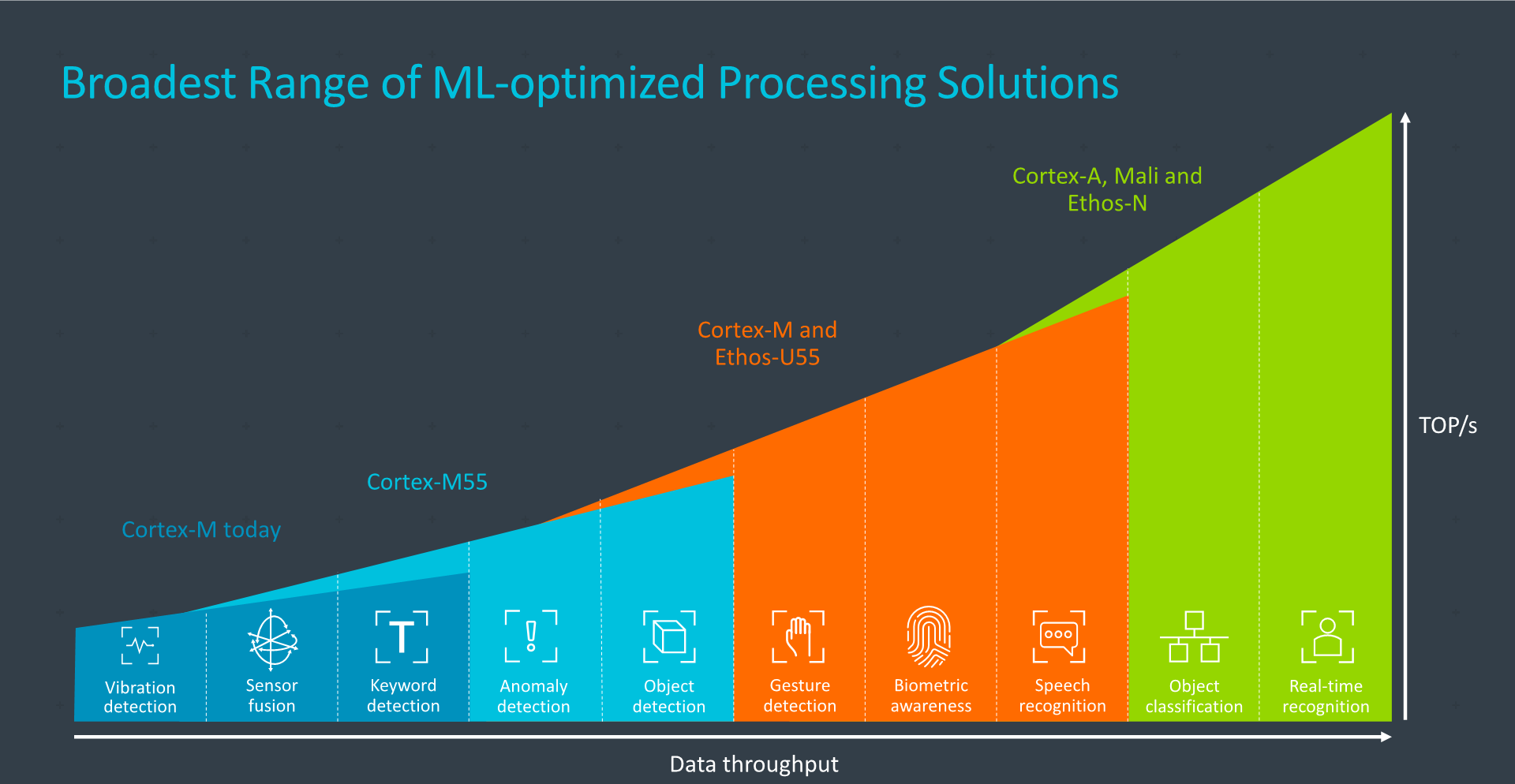

Usado em conjunto, Arm's Cortex-M55 e Ethos-U55 têm poder de processamento suficiente para aplicativos como reconhecimento de gestos, biometria e reconhecimento de fala ( Imagem:Armar)

No entanto, alcançar um aprendizado de máquina significativo com dispositivos em nível de microcontrolador não é uma tarefa fácil. A memória, um critério chave para cálculos de IA, costuma ser severamente limitada, por exemplo. Mas a ciência de dados está avançando rapidamente para reduzir o tamanho do modelo, e os fornecedores de dispositivos e IP estão respondendo desenvolvendo ferramentas e incorporando recursos personalizados para as demandas do aprendizado de máquina moderno.

TinyML decola

Como um sinal do rápido crescimento deste setor, o TinyML Summit, um novo evento do setor realizado em fevereiro no Vale do Silício, está crescendo cada vez mais. A primeira cúpula, realizada no ano passado, teve 11 empresas patrocinadoras; o evento deste ano teve 27, e os slots se esgotaram muito antes, de acordo com os organizadores. A participação nos encontros globais mensais da TinyML para designers cresceu dramaticamente, disseram os organizadores.

“Vemos um novo mundo com trilhões de dispositivos inteligentes habilitados por tecnologias TinyML que detectam, analisam e agem autonomamente em conjunto para criar um ambiente mais saudável e sustentável para todos”, disse Evgeni Gousev, diretor sênior da Qualcomm, copresidente do Comitê TinyML , em seus comentários de abertura em uma conferência recente.

Gousev atribuiu esse crescimento ao desenvolvimento de hardware e algoritmos com maior eficiência energética, combinados com ferramentas de software mais maduras. O investimento corporativo e de capital de risco está aumentando, assim como as atividades de inicialização e fusões e aquisições, observou ele.

Hoje, o Comitê TinyML acredita que a tecnologia foi validada e que os produtos iniciais que usam aprendizado de máquina em microcontroladores devem chegar ao mercado em dois a três anos. Acredita-se que os “aplicativos assassinos” levem de três a cinco anos.

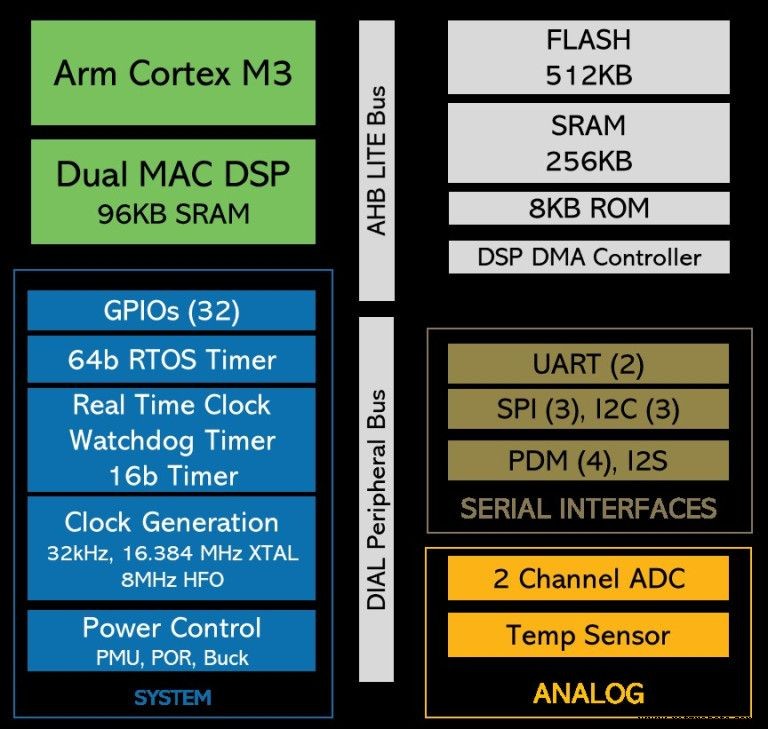

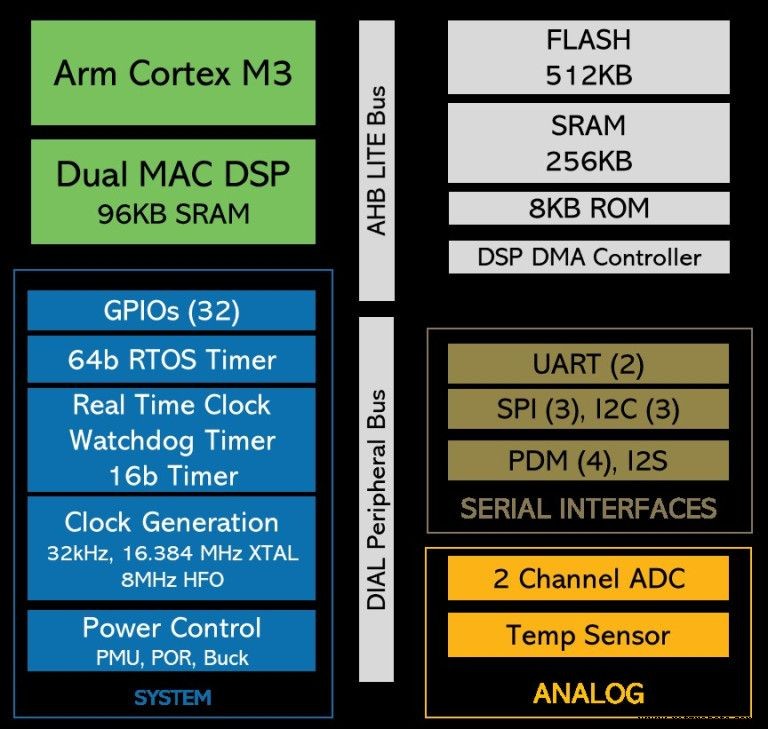

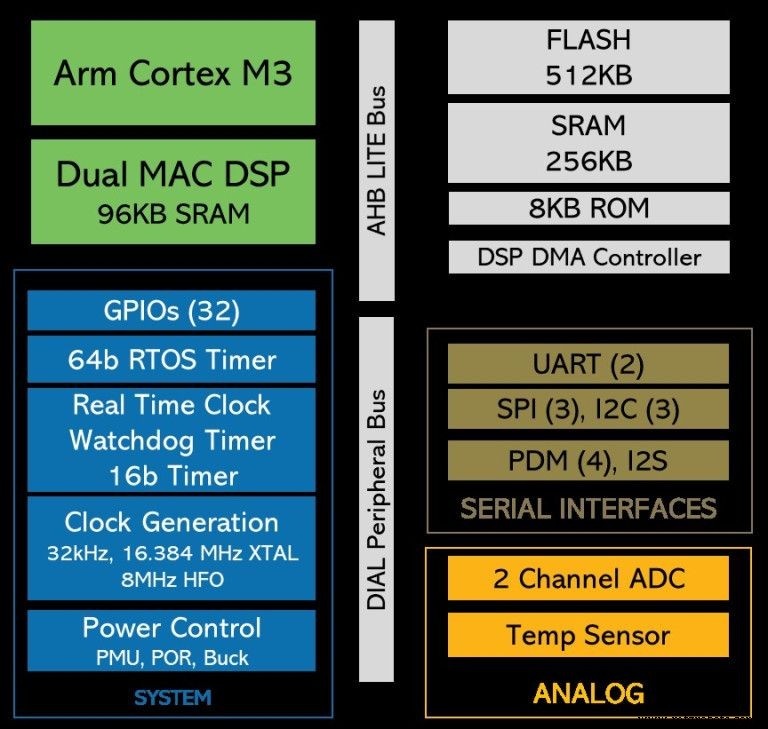

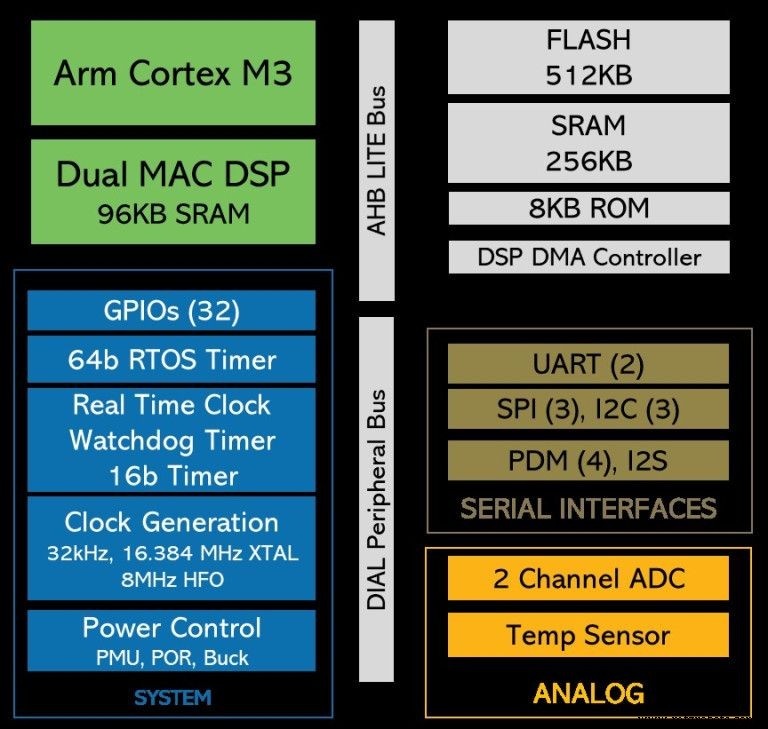

Grande parte da validação da tecnologia ocorreu na primavera passada, quando o Google demonstrou pela primeira vez uma versão de sua estrutura TensorFlow para microcontroladores. O TensorFlow Lite para Microcontroladores foi projetado para ser executado em dispositivos com apenas kilobytes de memória (o tempo de execução principal cabe em 16 KB em um Arm Cortex-M3; com operadores suficientes para executar um modelo de detecção de palavras-chave de fala, ele ocupa um total de 22 KB ) Suporta inferência, mas não treinamento.

Grandes jogadores

Os grandes fabricantes de microcontroladores, é claro, estão observando os desenvolvimentos na comunidade TinyML com interesse. À medida que a pesquisa permite que os modelos de rede neural diminuam, as oportunidades aumentam. A maioria tem algum tipo de suporte para aplicativos de aprendizado de máquina. Por exemplo, a STMicroelectronics tem um pacote de extensão, STM32Cube.AI, que permite mapear e executar redes neurais em sua família STM32 de microcontroladores baseados em Arm Cortex-M.

O ambiente de desenvolvimento e-AI da Renesas Electronics permite que a inferência de AI seja implementada em microcontroladores. Ele efetivamente traduz o modelo em uma forma que pode ser usada no estúdio e2 da empresa, compatível com projetos C / C ++.

A NXP Semiconductors disse que tem clientes que usam seus MCUs Kinetis e LPC de última geração para aplicativos de aprendizado de máquina. A empresa está adotando a IA com soluções de hardware e software, embora principalmente orientada em torno de seus maiores processadores de aplicativos e processadores crossover (entre processadores de aplicativos e microcontroladores).

Braço forte

A maioria das empresas estabelecidas no espaço dos microcontroladores têm uma coisa em comum:Arm. A gigante do núcleo do processador embarcado domina o mercado de microcontroladores com sua série Cortex-M. A empresa anunciou recentemente o novo núcleo Cortex-M55, que é projetado especificamente para aplicativos de aprendizado de máquina, especialmente quando usado em combinação com o acelerador Ethos-U55 AI da Arm. Ambos são projetados para ambientes com restrição de recursos. Mas como as startups e empresas menores podem buscar competir com os grandes players desse mercado?

“Não construindo SoCs baseados em Arm, porque [os participantes dominantes] fazem isso muito bem”, riu o CEO da XMOS, Mark Lippett. “A única maneira de competir contra esses caras é tendo uma vantagem arquitetônica ... [isso significa] as capacidades intrínsecas do Xcore em termos de desempenho, mas também a flexibilidade.”

O Xcore.ai da XMOS, seu processador crossover recém-lançado para interfaces de voz, não vai competir diretamente com os microcontroladores, mas o sentimento ainda é verdadeiro. Qualquer empresa que esteja fazendo um SoC com base na Arm para competir com os grandes é melhor ter algo muito especial em seu molho secreto.

>> Continue lendo a página dois deste artigo publicado originalmente em nosso site irmão, EE Times Europe.

Integrado

- Modelos SPICE

- Modelos de amplificadores operacionais

- Memória de mudança de fase incorporada de amostragem ST para microcontroladores automotivos

- NVIDIA:Computador CUDA-X AI que executa todos os modelos AI

- Salva-vidas

- Como fazer fibra de vidro

- Modelagem de Materiais de Metais em Abaqus

- HPE aplica DevOps a modelos de IA

- Transformando dados em decisões

- Aplicações do Centro de Usinagem. Modelos e aplicações?