Chip AI lida com cargas de trabalho simultâneas

A empresa também disponibilizará seus modelos de IA para veículos autônomos aos desenvolvedores.

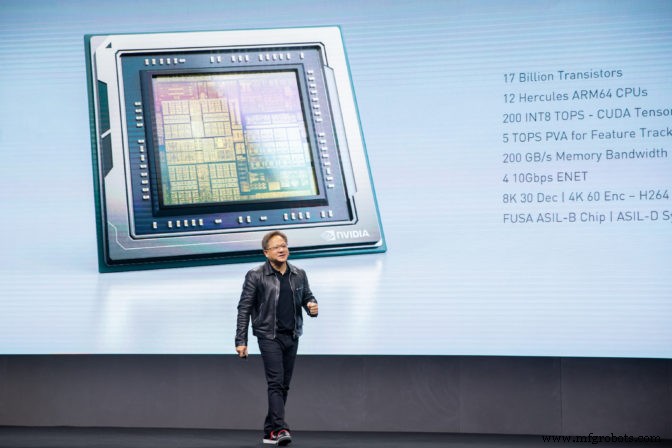

Na GPU Technology Conference (GTC) da empresa em Suzhou, China, o CEO da Nvidia, Jensen Huang, subiu ao palco para apresentar o Drive AGX Orin, a próxima geração de SoC no portfólio automotivo da empresa.

Orin segue o Drive AGX Xavier, lançado há pouco menos de 2 anos na CES 2018. Xavier é o atual carro-chefe da Nvidia SoC para aceleração de IA em veículos.

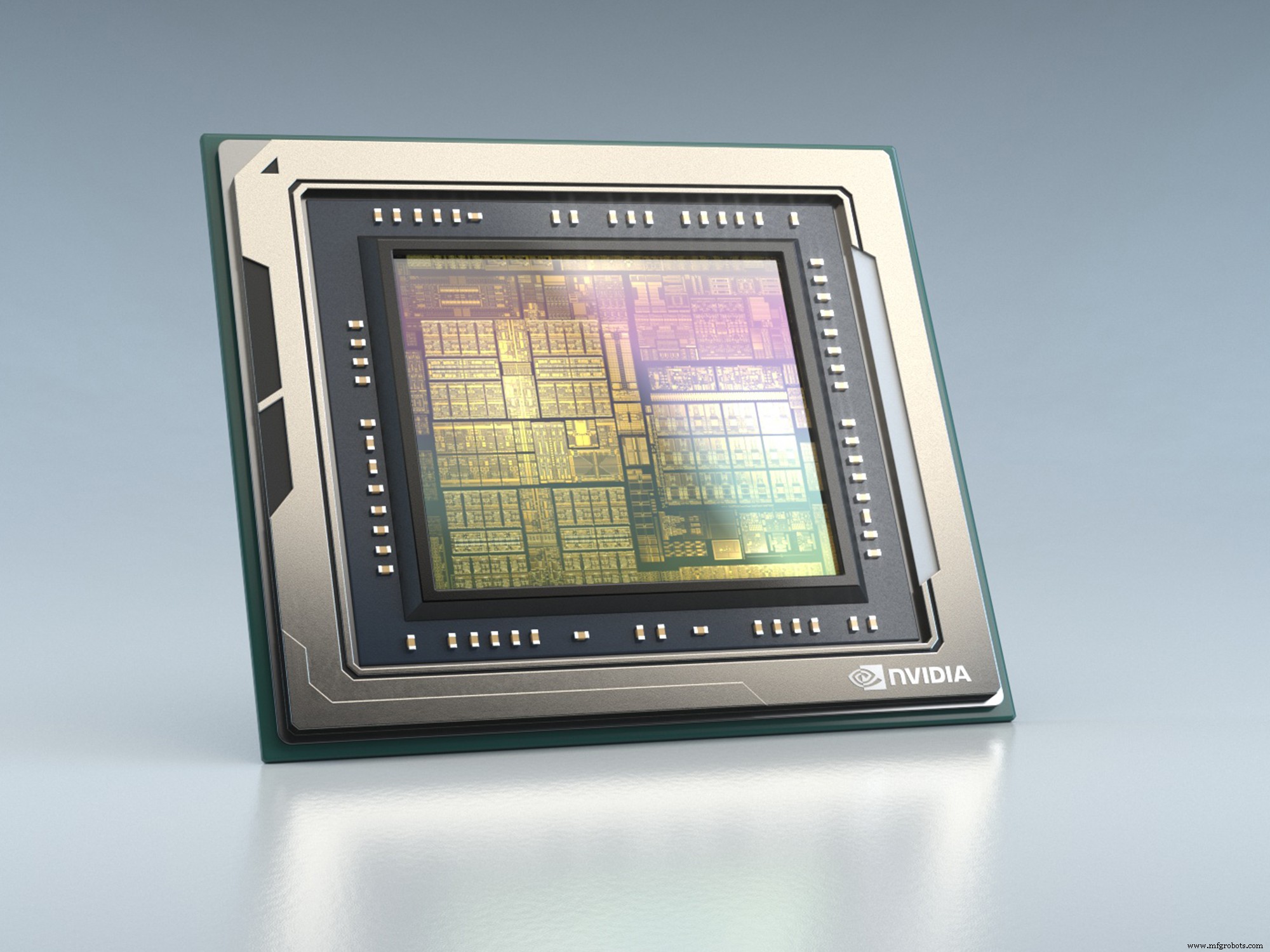

Orin, com 17 bilhões de transistores, é quase o dobro do tamanho do Xavier, que tinha 9 bilhões, e oferece quase 7x o desempenho (200 TOPS para dados INT8). Apesar de seu tamanho, Orin também oferece 3 vezes a eficiência de energia do Xavier, disse a empresa.

“[Isso é] um grande impulso [no desempenho], mas não é apenas sobre o TOPS, é sobre a arquitetura sendo projetada para cargas de trabalho muito complexas, algoritmos muito diversos e redundantes que precisam ser executados dentro de um veículo autônomo, que será tratado pelo Xavier hoje e Orin no futuro ”, disse Danny Shapiro, diretor sênior automotivo da Nvidia.

O CEO da Nvidia, Jensen Huang, apresenta Orin ao público na conferência de tecnologia de GPU da empresa na China (Imagem:Nvidia)

Orin usará 12 CPUs Hercules ARM64 ao lado de núcleos de GPU Nvidia de próxima geração e novos aceleradores de aprendizado profundo e visão computacional, que a empresa não revelou.

Ele será usado em veículos autônomos (em projetos do Nível 2 ao Nível 5) e robótica, onde muitas redes neurais e outras aplicações precisam ser executadas simultaneamente, enquanto atinge os níveis de segurança ISO 26262 ASIL-D. Fazendo uso da plataforma Nvidia Drive, Orin será um software compatível com o Xavier.

A família Orin incluirá uma variedade de configurações com base em uma única arquitetura e estará disponível para execuções de produção do cliente em 2022.

Aprendizagem Federada

A Nvidia também anunciou uma parceria com a Didi. Didi é um provedor de transporte baseado em aplicativo (semelhante ao Uber), ativo na Ásia, América Latina e Austrália.

Didi usará GPUs Nvidia em seu data center para treinar algoritmos de aprendizado de máquina e a plataforma Nvidia Drive para inferência em seus veículos autônomos de nível 4. A empresa transformou sua unidade de negócios de direção autônoma em uma empresa separada em agosto. Ela também lançará serviços de nuvem GPU virtual para clientes baseados em GPUs Nvidia.

Em um anúncio separado, a Nvidia revelou que fará modelos pré-treinados para redes neurais profundas (DNNs) que desenvolveu para o Nvidia Drive disponíveis gratuitamente para desenvolvedores de veículos autônomos. Incluem modelos para a detecção de semáforos e sinais, bem como outros objetos como veículos, pedestres e bicicletas. Eles também incluem a percepção do caminho, detecção de olhar e algoritmos de reconhecimento de gestos.

Orin oferecerá 200 TOPS, 7x o desempenho do Xavier com 3x a eficiência energética (Imagem:Nvidia)

É importante ressaltar que esses modelos podem ser customizados por meio de ferramentas fornecidas pela empresa, e podem ser atualizados por meio de aprendizagem federada. Aprendizagem federada é uma técnica em que o treinamento é feito localmente no limite, preservando a privacidade dos dados, antes que um modelo central seja atualizado com os resultados do treinamento de várias fontes.

“O veículo autônomo AI é um veículo definido por software necessário para operar em todo o mundo em uma ampla variedade de conjuntos de dados”, disse Jensen Huang, CEO da Nvidia. “Ao fornecer aos desenvolvedores de AV acesso aos nossos DNNs e às ferramentas de aprendizagem avançadas para otimizá-los para vários conjuntos de dados, estamos permitindo o aprendizado compartilhado entre empresas e países, ao mesmo tempo em que mantemos a propriedade e a privacidade dos dados. Em última análise, estamos acelerando a realidade dos veículos autônomos globais. ”

Integrado

- Projetando com Bluetooth Mesh:Chip ou módulo?

- Módulo Tiny Bluetooth 5.0 integra antena de chip

- Os pesquisadores criam uma pequena etiqueta de identificação de autenticação

- Processadores especializados aceleram cargas de trabalho de IA de endpoint

- Processador de radar de imagem automotiva de 30 fps estreia

- Chip de radar de baixa potência usa redes neurais com pico

- O design de referência suporta cargas de trabalho de IA com uso intensivo de memória

- Sensor de pulmão-coração em miniatura em um chip

- O que são transportadores de cavacos?

- Uma introdução aos transportadores de cavacos