Detecção de Veículos Aéreos Não Tripulados Usando Visão Computacional

Resumo

Com a inovação em tecnologia, a segurança está se tornando o maior problema a ser tratado. A acessibilidade exponencialmente crescente dos drones tem representado uma grande ameaça à segurança geral. O uso de UAVs aumentou nos últimos anos. Tendo em mente os problemas de segurança aqui, uma solução é sugerida. Primeiro, detecte UAVs e, em seguida, rastreie seu caminho.

Para detecção de objetos, os algoritmos de aprendizado profundo da Visão Computacional são muito eficazes. A entrada é processada pelo YOLO, que é uma rede neural usada para detecção e rastreamento de objetos em tempo real.

2.1 Compreendendo o conceito de UAV

De acordo com o título “Detecção e rastreamento de UAV usando visão computacional”, UAV (veículo aéreo não tripulado) é uma aeronave sem piloto, que pode ser controlada remotamente ou por computadores de bordo.

UAVs podem ser usados para fins benéficos, como agricultura, pesquisa científica, previsão do tempo, transporte e entrega, operações de resgate e assistência médica. Ele pode ser usado para fins de desastres, como ataques, ataques de mísseis, morte de alvos, etc.

2.2 O que é uma visão computacional?

Visão computacional é o campo da ciência que faz com que os computadores vejam, identifiquem e processem imagens da maneira que a visão do olho humano faz e para fornecer uma saída adequada. A visão computacional é usada em quase todos os campos, ou seja:

- Objeto, detecção de rosto

- Cirurgia robótica e diagnóstico médico

- Processamento de imagem

- Agricultura

- Tecnologia espacial (NASAs Mars Rover inclui recursos para modelar o terreno do planeta, detectar obstáculos em seu caminho e unir imagens panorâmicas) As aplicações de visão computacional são mostradas na figura 1.4

2.3 O que é a técnica de processamento de imagem?

O Processamento de Imagem técnica é usada pela visão computacional para executar diferentes tarefas. A operação realizada e os métodos aplicados para melhorar a qualidade de uma imagem ou para obter um resultado específico após ser obtido como uma pilha de imagens é denominado processamento de imagem.

O processamento de imagem é considerado uma das áreas da tecnologia da informação em evolução mais rápida atualmente, com aplicações crescentes em todas as áreas de negócios. As aplicações do processamento de imagens são:

Casos de uso de processamento de imagem

O processamento de imagem pode ser usado nestes campos:

- Robótica

- Medicina

- Reconhecimento de padrão

- Processamento de vídeo

- Detecção de rosto

2.4 Requisitos de software

- Anaconda

- Spyder

- Python

- Biblioteca Open-CV

3. Algoritmos para detecção de objetos

Muitos algoritmos estão presentes para detecção de objetos. Alguns deles são os seguintes:

- VOILA E JONES

- Redes Neurais Convolucionais (CNN)

- Você só olha uma vez (YOLO)

- Detetor de disparo único (SSD)

- Redes Neurais Convolucionais da Região (R-CNN)

Tabela 3.1:Algoritmos para detecção

| Algoritmo | Descrição | Força | Fraqueza |

| VOILA AND JONES (The Viola-Jones O algoritmo foi projetado por Paul Viola e Michael Jones em 2001) | O objetivo principal era a detecção de rostos e objetos. Ele pode detectar objetos em tempo real. Quando damos algoritmos de imagem, analisamos sub-regiões menores e tentamos encontrar objetos observando recursos especiais em cada sub-região. O algoritmo Viola e Jones usa recursos semelhantes ao Haar para detectar objetos |

|

|

| CNN (Convolutional Neural Networks) Introduzido por Kunihiko Fukushima em 1980 | O modelo hierárquico de inspiração biológica que pode ser treinado para realizar a verificação da detecção, reconhecimento e segmentação. É basicamente um algoritmo de aprendizado profundo, ele recebe imagens como entrada, atribui pesos e vieses aprendíveis ao objeto presente na imagem e diferencia entre um e outro |

|

|

| YOLO (Você só olha uma vez) | É um algoritmo de detecção em tempo real. Ele aplica o algoritmo de rede neural à imagem e divide a imagem em grade S x S e cria limites em torno das imagens e prevê possibilidades para cada um dos limites. Usa regressão. |

| 1. Detecta um objeto por célula da grade. 2. Prefira o alto desempenho à precisão. |

| SSD (detector de disparo único) | Este método faz apenas um disparo para detectar vários objetos. Esse método é muito rápido. Ele é projetado para implementação em tempo real. Ele contém dois componentes de backbone e cabeçote SSD. |

|

|

Aqui será usado o algoritmo de rede neural Yolo. Este algoritmo é muito rápido para implementação em tempo real. Ele usa um algoritmo de rede neural e divide a imagem em grade S x S e faz um limite ao redor da imagem para prever possibilidades para cada limite. Os algoritmos para detecção são mostrados na Tabela 4.4.

3.1 Algoritmo para rastreamento

Depois de detectar um objeto, o próximo foco está no caminho certo. Se o objeto detectado for uma pipa ou pássaro, não há necessidade de rastreamento, mas se o objeto detectado for um drone, o alvo será rastreado.

Muitos algoritmos são usados para rastreamento de objetos. Mas, novamente, o YOLO é usado para rastreamento porque esse algoritmo é rápido e preciso e pode detectar e rastrear até que o alvo saia do alcance da câmera.

4. Implementação do projeto proposto

Aqui está a implementação do projeto proposto. No qual são executadas todas as etapas necessárias para executar o projeto no software.

4.1 Fase inicial

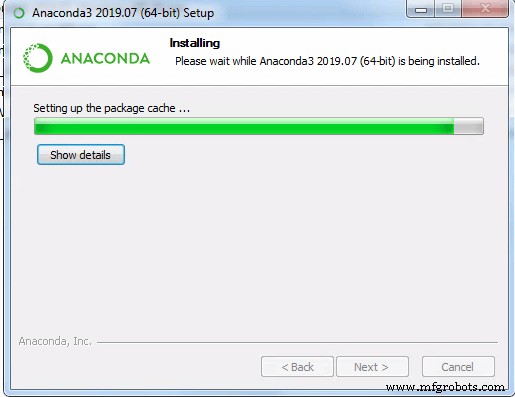

- O processamento de imagem precisa de uma boa CPU/GPU, escolha CPU. Instale o anaconda a partir do site A instalação do Anaconda é mostrada na figura 4.1

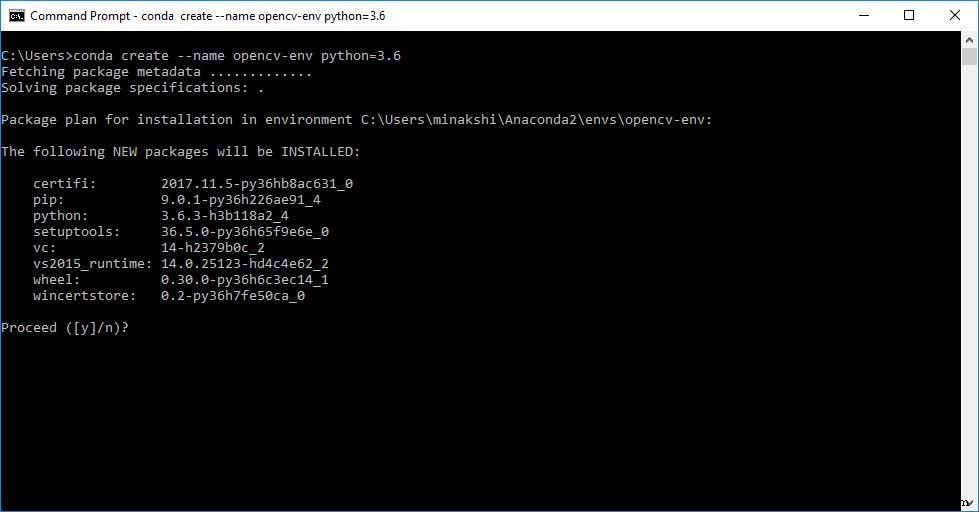

- Após a instalação do Anaconda Navigator, crie um ambiente com a ajuda da caixa de diálogo do ambiente e selecione a versão do python.

- Depois de criar um ambiente com sucesso, o próximo passo é instalar o Spyder, pois é fácil de usar. Em seguida, instale o CV aberto através do comando pip install cv2.

4.2 Preparando o conjunto de dados

- Colecione muitas imagens de diferentes objetos aéreos, como drones, pássaros, aviões, helicópteros, pipas e balões.

Observação: Fazer um conjunto de dados é mais do que apenas coletar imagens. Dando os nomes das imagens e também informando a posição desses objetos específicos em cada imagem. Para isso, um software chamado Labellmg pode é usado, que converte imagens em arquivos de texto. Conforme mostrado na figura 4.6

- Uma vez que os arquivos Txt de todos os objetos são feitos. Coloque todas as imagens e arquivos de texto em um arquivo zip. Além disso, nomeie o arquivo para as classes incluídas.

4.3 Configuração YOLO

Para configuração, siga estas etapas:

- Instale darknet com YOLO v3.

- Para configurar o YOLO crie uma pasta na darknet/data incluindo todas as imagens e arquivos .txt do dataset que foi feito anteriormente.

- Para fazer um arquivo de configuração personalizado, faça as modificações necessárias no YOLO v3 do cfg, ajustando lote, subdivisões e lotes máximos em relação a classes e etapas.

- Ao inserir o número de classes, altere a camada convolucional acima de YOLO. Também defina random para 1. Os parâmetros cfg são mostrados na Tabela 4.1

Tabela 4.1:Parâmetros CFG

| Nome | Descrição |

| Lote | Quantas imagens e rótulos são usados na passagem direta para calcular um gradiente e atualizar os pesos por meio do método de retropropagação. |

| Subdivisões | O lote é subdividido em vários ”blocos”. As imagens de um bloco são executadas em paralelo. |

| Etapas | 500.1000:ajuste a taxa de aprendizado após 500 e 1.000 lotes. |

| Camadas (Filtros) | Quantos kernels convolucionais existem em uma camada. |

| Camadas (Aleatórias) | Coloque as camadas YOLO. Se definido como 1, faça o aumento de dados redimensionando as imagens para tamanhos diferentes a cada poucos lotes, usado para generalizar sobre tamanhos de objetos. |

- Crie uma pasta de objetos personalizados através de data/obj.names na qual estão escritos todos os nomes que queremos detectar como drones, UAVs, pássaros, pipas, etc.

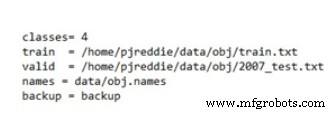

- No número de classes obj.data, train.txt, válido, nomes e pastas de pesos são incluídos e salvos.

- No train.txt todos os dados e nomes das imagens são salvos.

4.4 Treinando o YOLO em seu conjunto de dados

O treinamento do YOLO para um conjunto de dados personalizado também é feito através da darknet. Clone e habilite a darknet, bem como habilite o CV aberto. Pegando a pasta ZIP, arquivo .cfg, arquivo .names, arquivo obj.data e arquivo train.txt criados acima, então configure a rede darknet para o treinamento do YOLO v3, contando as execuções.

Depois de milhares de iterações que podem levar cerca de 2 horas com base em nossa capacidade de CPU, um conjunto de dados treinado estará pronto para ser usado e integrado ao nosso sistema, informando a perda média.

4.5 Testando o código na entrada de imagem e vídeo

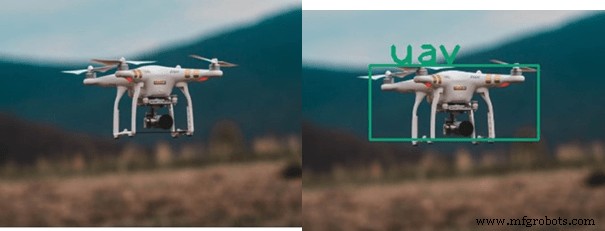

Depois de treinar o YOLO para o conjunto de dados personalizado, comece a testar o código em seu conjunto de dados treinado, chamado de pesos YOLO. Tem 4 classes neste caso.

Tente a detecção YOLO em diferentes. Grandes pesos são bons em termos de precisão, mas o processamento é um pouco lento devido aos baixos quadros por segundo. Faça vídeo de UAV, pássaros e dê esses dados como entrada para o código. Todos os objetos serão detectados e rastreados com sucesso com os rótulos dados fps e limite.

Agora o código pode ser testado para cenários em tempo real através da entrada em tempo real da webcam alterando o alcance de nossa câmera voou nosso UAV com a gravação do resultado você verá a saída conforme necessário ”Detecção e rastreamento de UAV”.

Tecnologia industrial

- Visão computacional como sensor de movimento para SmartThings

- SONBI ROBOT DETECÇÃO HUMANA USANDO KINECT E RASPBERRY PI

- Os benefícios do uso de visão robótica para aplicativos de automação

- 4 vantagens de usar a solução inteligente de detecção de vazamentos em edifícios

- 5 vantagens de usar o sistema de detecção de vazamento de água alimentado por IoT Biz4intellias nas indústrias

- 7 aplicativos de visão computacional

- Visão por Computador

- Veículo aéreo não tripulado de alta altitude (UAV) para monitoramento de parâmetros meteorológicos

- Evitando distorção de imagem induzida pelo calor em câmeras de varredura de linha de visão de máquina

- 24 Unidade 7:Mastercam