Visão e robótica:felizes juntos

A próxima “dupla dinâmica” pode não envolver humanos. “A visão de máquina e os robôs formam um casamento perfeito”, afirmou Klas Bengtsson, gerente global de produtos, sistemas de visão da ABB Robotics (Auburn Hills, MI). Isso não é novo. Visão e robótica andam de mãos dadas há anos. Mas, ao contrário de outros casamentos, este está prosperando à medida que a visão de máquina está se expandindo em capacidade e encontrando novas aplicações. O casamento “perfeito” do passado envolvia guiar o robô. Mas novas aplicações - como filhos de um bom casamento - agora incluem inspeção de peças, leitura de códigos de barras ou QR para rastreabilidade e descoberta de novas maneiras de embalar e desembalar peças.

Tudo se resume à flexibilidade que a visão de máquina oferece . “A Vision ajudou a ABB a aprimorar os recursos de muitas aplicações robóticas”, disse ele.

A necessidade de robôs guiadores flexíveis foi impulsionada pelo aumento da diversidade de produtos e pela necessidade de reduzir os prazos de entrega em muitos setores. Por que a flexibilidade é tão importante? “Se você codifica a automação robótica, no minuto em que você muda um produto ou algo em sua linha de produção, você deve mudar o programa”, disse Bengtsson. Isso também significa alterar a fixação de precisão ou a maneira de colocar uma peça para que um programa de orientação de robô codificado possa coletar, polir ou operar a peça de forma confiável. Os custos se somam.

A visão de máquina ajuda a conter esses custos ao permitir que o robô “veja” variações nas peças e na orientação. Os sensores de digitalização 3D estão abrindo ainda mais novos aplicativos. Disse Bengtsson:"A pergunta há 15 anos era 'Por que usar visão de máquina'. A pergunta hoje é:'por que não?'"

Humanos e robôs colaboram

A Rethink Robotics (Boston), fundada em 2008, constrói robôs colaborativos, ou cobots. Seu principal produto é Sawyer. “Um cobot como nosso robô Sawyer é melhor usado executando tarefas repetitivas e mundanas que são de escala humana”, disse Mike Fair, gerente de produto. Isso significa trabalhar com produtos ou movimentos que replicam o que um humano faz que também é repetitivo e mundano.

“Aplicações como esta incluem embalagem, manutenção de máquinas, carregamento e descarregamento de linha, inspeção e teste de placa de circuito impresso”, disse ele. O manuseio de materiais para máquinas CNC é outra aplicação, substituindo um humano que carrega uma máquina CNC, faz o ciclo, espera a tarefa de usinagem terminar e depois descarrega a máquina.

A Rethink acredita tanto na visão de máquina que incorpora uma câmera no pulso de cada Sawyer. “O sistema de visão incorporado [torna] nosso cobot mais rápido e fácil de implantar, eliminando problemas e tempo de integração dispendioso de sistemas típicos de visão de máquina. Adicionamos software para facilitar a implantação desses sistemas de visão”, disse Fair. Na feira ATX West 2018, ele fez uma demonstração provando que até um jornalista pode programar uma tarefa simples em poucos minutos. Em conjunto com adesivos codificados que se parecem com códigos QR, seu software ajuda o robô a se posicionar para se adaptar à variabilidade na célula de trabalho. Isso também facilita a movimentação dos robôs Sawyer de uma tarefa para outra e de um local para outro.

A Universal Robots USA Inc. (UR; Ann Arbor, MI) também se dedica a robôs colaborativos. Seus três robôs, com carga útil de 3 a 10 kg, operam dentro de um “ecossistema” de fornecedores terceirizados. Ele oferece um programa de desenvolvedor gratuito chamado Universal Robots+ para permitir que fornecedores terceirizados de efetores finais, sistemas de visão e outros periféricos desenvolvam complementos que plug-and-play com seus cobots.

O site da empresa mostra seis opções diferentes de visão dentro este ecossistema que são adequados para pick and place, automação de máquinas CNC, embalagem e paletização, montagem, aparafusamento e manutenção de máquinas. Ambos os scanners 2D e 3D estão disponíveis. Vários pacotes de software de simulação e controle de movimento do robô estão disponíveis.

Integração, Facilidade de Uso

Para que a visão de máquina seja útil, ela deve ser acessível, um elemento importante do ecossistema da UR. Por exemplo, um de seus pacotes de terceiros é chamado Universal Metrology Automation, oferecido pela 3D Infotech. Ele oferece integração de sistemas de controle de movimento, scanners 3D e software de inspeção para criar uma solução de metrologia automatizada e configurável. Outros programas fornecem programação online ou offline, software de simulação robótica e recursos de monitoramento.

"Hoje há uma integração muito melhor com robôs e sistemas de visão", disse Rob Antonides, presidente da Apex Motion Control (Surrey, BC). A Apex é um integrador que aproveitou ao máximo a abordagem de ecossistema da UR. “Costumávamos ter que hackear sistemas de visão com controladores de robôs, mas hoje eles são mais plug-and-play, via Ethernet IP ou qualquer tipo de rede. Vinte anos atrás, eu costumava levar uma semana para montar um sistema robótico guiado por visão e as comunicações; hoje é de 15 a 20 minutos.”

A visão de máquina provou ser especialmente útil para o Apex. As tarefas automatizadas incluem uma variedade de operações de cozimento, incluindo a decoração de bolos. “Os sistemas de visão permitem lidar com inconsistências e apresentação e posicionamento menos que perfeitos do produto. Mapeamos a superfície de um bolo com um sensor 3D para que possamos decorá-lo de forma rápida e fácil”, disse Antonides.

FANUC também enfatiza a integração fácil. “Lançamos um controlador totalmente novo no final do ano passado, com funções proeminentes para visão robótica integrada”, explicou David Dechow, engenheiro de equipe de robótica/visão de máquina inteligente da FANUC America Corp. (Rochester Hills, MI). “Na FANUC, todos os nossos sistemas de visão estão agora integrados no controlador.” A FANUC foi uma das primeiras empresas de robôs a incluir a visão para a robótica de orientação, oferecendo-a há 30 anos como opção nos seus sistemas de orientação robótica.

Dechow também observou que as empresas de visão de máquina se concentraram no desenvolvimento de interfaces mais fáceis com robôs. “Os fornecedores de visão estão visivelmente apoiando este mercado”, afirmou. “O trabalho pesado para fazer a colaboração funcionar está no lado da visão. O robô está esperando um ponto. O truque é usar a visão de máquina para encontrar o ponto certo, mesclando o sistema de coordenadas do sistema de visão de máquina com o sistema de coordenadas do robô.” Ele concordou com outros entrevistados para este artigo que a visão de máquina fornece flexibilidade incomparável em muitas tarefas de automação. Hoje, a relação custo/benefício está começando a favorecer a visão sobre fixação de precisão e codificação, disse ele.

IA:pose e discriminação

Uma discussão sobre visão, dados e robôs naturalmente leva à questão de quão útil a Inteligência Artificial (IA) seria para robôs com visão. Dechow observou um problema – a IA não é particularmente aplicável à orientação robótica. “A aprendizagem de IA é excepcionalmente boa em categorização e diferenciação. O que não é bom é na análise discreta”, explicou. Um robô precisa se mover para um ponto discreto. Quando combinado com sistemas de metrologia, mede quantidades geométricas discretas. "Não há nada para aprender", disse ele.

Mas não termina aí. Se não for aplicável à orientação, existem tarefas robóticas em que a IA oferece valor. “Por exemplo, identificar e classificar um objeto em relação ao seu plano de fundo para determinar o objeto no qual o robô deve operar, combinado com a orientação robótica, seria uma boa aplicação híbrida”, disse ele. Outra está na otimização de pick and grip. “Encontrar a orientação ideal do braço no espaço e o caminho de aproximação cai em um domínio de aprendizagem ao invés de ser determinístico. Há muitas orientações que são boas e ruins”, explicou. “A IA é especialmente útil onde as peças são aleatórias e não homogêneas no posicionamento e no tamanho.”

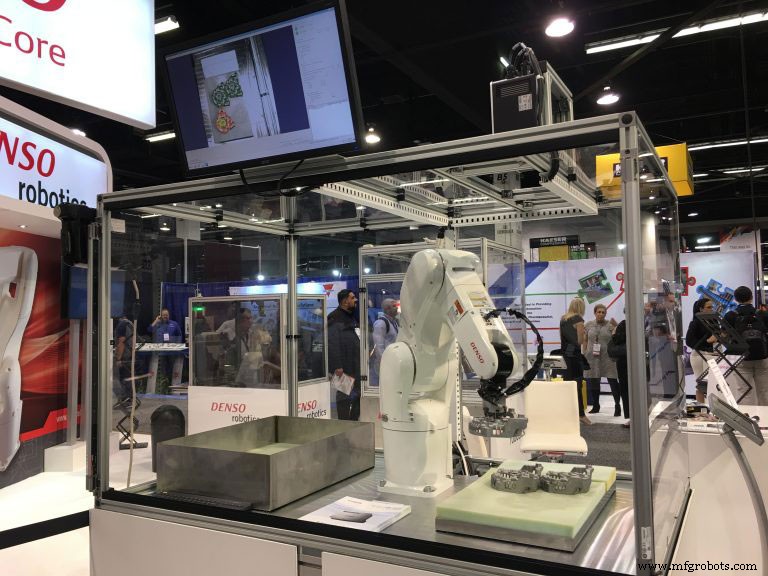

Peter Cavallo da Denso Products and Services Americas Inc. (Long Beach, CA) concordou que o aumento substancial na capacidade do sistema de visão é real e abriu novas oportunidades para aplicações robóticas. “Em sua forma mais simples, [visão] encontra uma parte ou objeto e opera sobre ele. Em sua forma mais complexa, que estamos vendo agora, ele pode ver coisas, interpretar, reconhecer e ver a peça pelo que ela é – mesmo em diferentes configurações ou posições – sem mover a peça ou o robô.”

Ele vê a digitalização 3D como um desenvolvimento especialmente importante, tornando simples tarefas anteriormente difíceis, como a coleta de lixo. O sistema mais recente da Denso usa um sistema de visão de luz estruturado para ver em 3D com um detector CMOS.

Sua visão da aplicação da IA à robótica é baseada em um contexto de sistema mais amplo. “À medida que avançamos para a próxima geração de robôs, estamos começando a entrar em coisas como aprendizado profundo, onde a visão se torna parte de um sistema inteiro”, explicou ele. “Exibimos algo no show de robôs de Tóquio que mostrou aprendizado profundo em um sistema com 28 graus de liberdade que incluía dois robôs com mãos que montavam uma salada.” Por que os usuários industriais devem ficar impressionados? O robô selecionou alface, frutas e legumes usando apenas o conhecimento fornecido de antemão. “Não programamos o robô; em vez disso, dissemos o que queríamos”, disse ele. Pense no número de tarefas não estruturadas que existem no chão de fábrica que seriam ideais para tal automação.

Não apenas para os grandes

Visão de máquina, integração, software e até IA podem fazer pensar que esse nível de automação robótica é apenas para empresas da Fortune 500. Esse não é o caso. “É altamente aplicável a pequenas e médias empresas porque a visão hoje tem um custo razoável. O que costumava ser de US$ 50.000 a US$ 100.000 agora é inferior a US$ 5.000. Não há razão para ser tímido”, disse Cavallo.

Rick Brookshire, gerente de produto da Epson America Inc. (Carson, CA), concordou que a automação robótica é ideal para pequenas e médias empresas (PMEs). “Além de clientes maiores que compram 50, 100 ou até 1.000 robôs, temos muitos clientes menores que compram um, dois ou três robôs”, disse ele. A Epson é especializada em robôs menores otimizados para tarefas de alta precisão, expandindo seu negócio de robôs a partir de suas próprias necessidades na construção de relógios de alta precisão. “Todos os nossos robôs estão disponíveis com orientação de visão integrada, um recurso que vem crescendo em aceitação. Também está se tornando mais confiável. As pessoas estão mais dispostas a usá-lo”, disse ele.

Como outros entrevistados para esta matéria, ele acredita na simplicidade é vital, especialmente para atender às necessidades das PMEs. O programa Epson Vision Guide usa uma interface GUI de apontar e clicar baseada em objetos, permitindo que os desenvolvedores desenvolvam aplicativos rapidamente, de acordo com a empresa. Embora a aplicação ideal do robô guiado por visão seja algo em que as peças não estejam bem posicionadas dentro de um nível de tolerância razoável ou não possam ser apresentadas de maneira consistente, a precisão que os robôs Epson fornecem abre outro domínio de uso.

As tolerâncias estão ficando mais apertadas. As peças estão cada vez menores. A colocação de precisão está ficando cada vez mais difícil. “É aí que robôs de precisão como os da Epson podem ajudar”, disse ele. “Isso está acontecendo cada vez mais em empresas menores. E esses robôs estão ficando tão fáceis de usar que muitos de nossos clientes fazem a integração por conta própria.” Os robôs até colocam parafusos com menos de 0,7 mm de diâmetro. À medida que a força de trabalho envelhece, isso pode se tornar um fator crítico.

James Cooper, vice-presidente de vendas da Applied Manufacturing Technologies (AMT; Orion, MI), tem uma perspectiva única baseada em sua experiência na indústria automotiva. A AMT é um integrador de sistemas especializado em sistemas de robôs guiados por visão. Vários números de peças com sistemas complexos, como em casos de transmissão, estão se tornando predominantes. Uma caixa de transmissão é um objeto grande com muitos orifícios e superfícies complexas - ideal para visão, mas caro para fixações rígidas de precisão. “Os tamanhos dos lotes também estão ficando menores com trocas mais frequentes. É por isso que os sistemas de visão guiada por robôs estão se tornando tão críticos em muitas aplicações.” Ele também observou o crescimento dos sistemas de visão 3D, especialmente em aplicações de separação de caixas e sacolas.

Vai além da orientação. “A inspeção de qualidade é uma aplicação ideal, procurando a presença e ausência de furos e outras características ou determinando se um componente foi montado corretamente”, disse ele. Outra área rica é na inspeção de metrologia. “Construímos um sistema com nosso parceiro Hexagon baseado em um robô colaborativo que inspeciona o produto de um cliente. Isso costumava ser feito em uma CMM em uma sala separada com temperatura controlada. Por muitos anos, os fabricantes quiseram fazê-lo no chão de fábrica. Agora é possível ter um sistema completamente portátil, sem proteção, ideal para aplicações de inspeção de primeiro artigo, diretamente na máquina de produção”, disse ele.

Ele concordou que essas aplicações estão crescendo nas PMEs. Ele também observou que essas operações estão lutando para encontrar mão de obra qualificada, impulsionando a necessidade de mais automação.

A ABB também desenvolveu um sistema de inspeção robótica através de uma colaboração com a NUB3D (que posteriormente adquiriu), uma inovadora líder em soluções de inspeção digital 3D e controle de qualidade. O sistema turnkey consiste em um sensor de varredura de luz branca 3D montado no braço de um robô ABB.

Stäubli Corp. (Duncan, SC) é uma empresa de robôs que usa uma variedade de visão de máquina de fornecedores terceirizados para criar aplicativos para orientação de visão de robôs. Mas também oferece outro uso de sistemas de visão com robôs industriais que precisam de interação humana:uma cerca de segurança virtual ao redor dos robôs.

As explained by Olivier Cremoux, business development manager, North America robotics for Stäubli, man/robot collaboration can be binned into five different stages. The lowest stage 1, common in most industrial robots, is no direct contact, where any interaction between man and machine is dangerous. “The robot and operator are separated by hard fences,” he said. The highest, stage 5, is where contact is desired and required, for example when a robot is hand guided by an operator to carry out or assemble a heavy tool or other simultaneous motions with a robot. There are stages in-between where some contact is desired at different levels, and where the robot often needs to stop and let the human do something. “This in-between represents 95% of collaborative applications,” he said.

In these intermediate stages, a 3D scanning vision system that scans outwards from the workcell can detect a human approaching. Within a certain distance, it signals the workcell to slow the robot down to prevent contact and possible injury. As the human approaches even closer, it stops the cell entirely. This allows the human to perform an action, such as inspection or placement, then move away, allowing the cell to automatically restart.

HNJ Solutions Inc. (Carson, CA) is an integration company founded to provide vision systems for manufacturing, including with robots, according to President Greg McEntyre. While acknowledging that vision systems are indeed becoming easier to use and install, he says there remains a class of applications where integrators like HNJ are needed. “In complex applications with multiple colors, sizes, orientations, and general uncertainty, it is important to know how cameras work and why they work to install a good system,” he said.

He emphasized how 3D cameras are expanding relevant applications, such as bin picking. “Today we are even importing the CAD model of our objects so that the vision system can understand in 3D the object it needs to pick or operate on,” he said. “Cameras give complete freedom.”

What advice might he offer, as an integrator of complex vision and robotics? “While it may not be easy as it looks, I would say just jump in,” he said. “There is so much useful hardware that vision guidance and vision applications are becoming ever more useful.” In other words, just do it.

Sistema de controle de automação

- Vantagens e desvantagens de um torno mecânico

- Fanuc abre nova instalação de robótica e automação

- ABB e B&R lançam a 'primeira solução de robótica centrada em máquina totalmente integrada'

- SICK apresentará webinar sobre personalização de visão de máquina

- Elementary Robotics arrecada US$ 13 milhões para suas ofertas de aprendizado de máquina e visão computacional para a indústria

- O papel da robótica e da automação na indústria 4.0

- Acionamentos e segurança da máquina

- Dispositivos de segurança e considerações

- ABB Robotics:inovação tecnológica e pesquisa e desenvolvimento de robótica

- Melhores juntos:maquinistas e programadores